DiffBrush是由北京邮电大学、清华大学、中国电信人工智能研究所和西北工业大学联合开发的一种无需训练的图像生成与编辑框架。该工具通过用户手绘草图实现对图像生成过程的直观控制,基于预训练的文本到图像(T2I)模型,结合颜色引导、实例与语义引导以及潜在空间再生等技术,精准控制生成图像的颜色、语义和实例分布。DiffBrush支持多种主流T2I模型,如Stable Diffusion、SDXL等,并兼容LoRA风格调整功能,使用户能够在画布上绘制简单的轮廓和颜色信息,即可生成符合需求的图像。该工具有效解决了传统T2I模型依赖文本提示的局限性,降低了AI绘画的技术门槛,为用户提供更加直观和高效的创作体验。

DiffBrush的主要功能

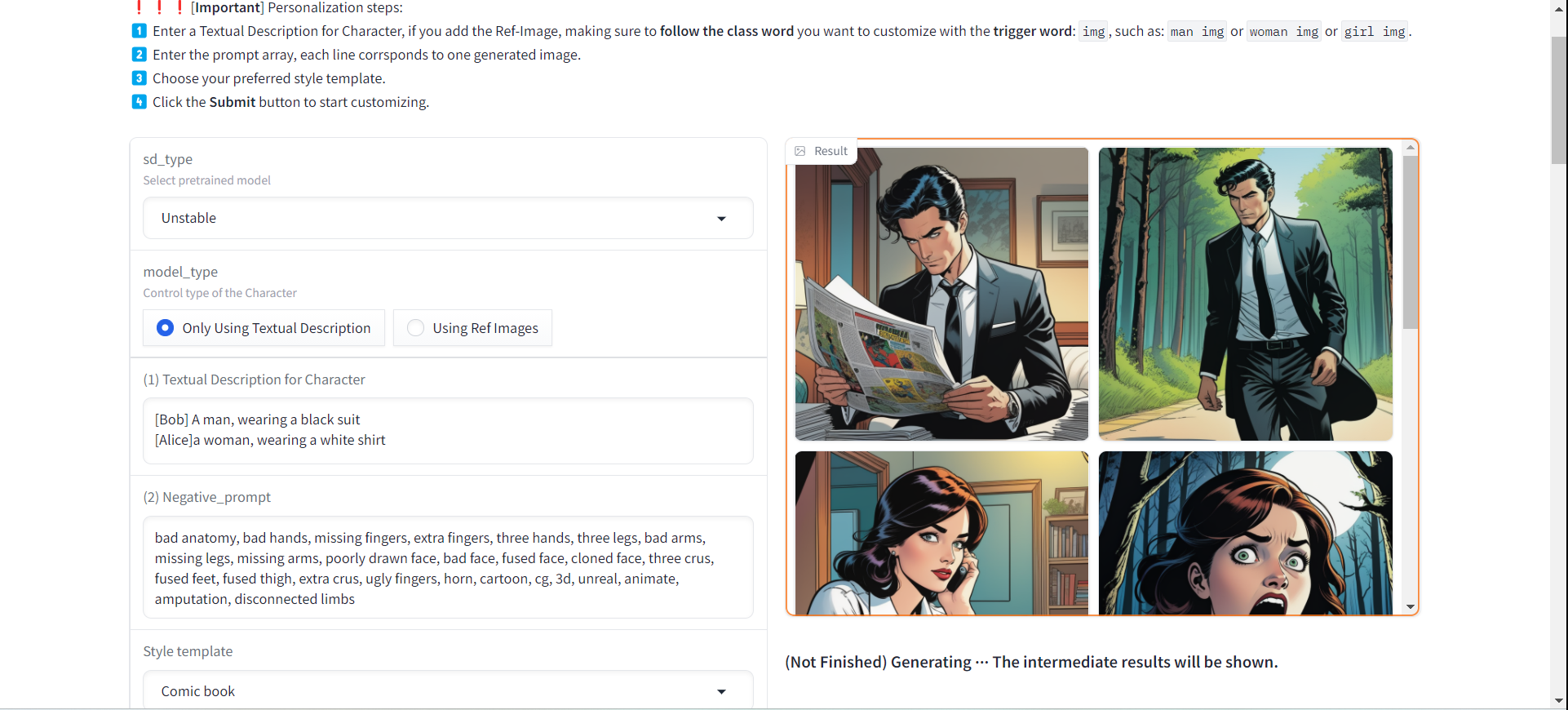

- 用户友好的图像生成:用户可通过手绘草图控制生成图像的内容,无需复杂的文本提示或技术知识。

- 颜色控制:根据用户绘制的颜色信息,精确控制生成图像中对应区域的颜色。

- 实例与语义控制:绘制实例的轮廓并标注语义信息,以控制生成图像中特定对象的位置和属性。

- 图像编辑:可在已有图像基础上进行添加、修改或替换操作。

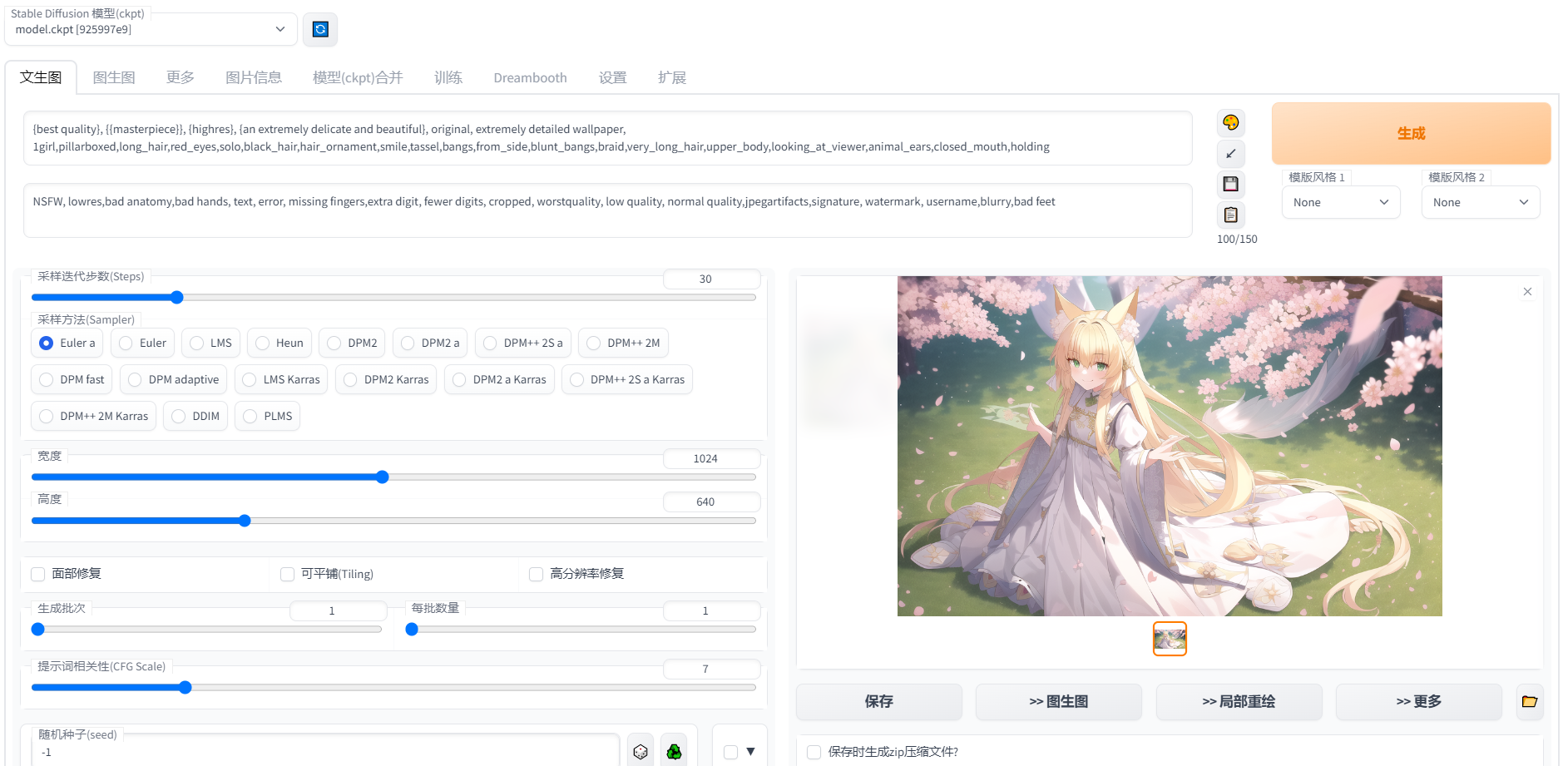

- 风格化生成:支持与LoRA风格调整结合,生成不同艺术风格的图像。

- 多模型兼容:兼容多种T2I模型,如Stable Diffusion、SDXL等,适用范围广泛。

DiffBrush的技术原理

- 扩散模型的引导机制:基于预训练的T2I模型,通过调整去噪方向,使生成图像更贴近用户提供的手绘草图。

- 颜色引导:利用潜在空间与颜色空间的相似性,通过能量函数引导生成图像的颜色。

- 实例与语义引导:通过注意力机制控制实例和语义,确保生成图像符合用户的意图。

- 潜在空间再生:通过优化噪声分布,提升生成图像质量。

- 用户交互与兼容性:提供简单界面,支持多种T2I模型及参数调节,提升用户体验。

DiffBrush的项目地址

- arXiv技术论文:https://arxiv.org/pdf/2502.20904

DiffBrush的应用场景

- 创意绘画:帮助艺术家快速将手绘创意转化为高质量图像。

- 图像编辑:适用于普通用户和设计师在现有图像上进行内容修改。

- 教育工具:用于艺术和设计教学,辅助学生理解构图与色彩。

- 游戏设计:快速生成游戏场景和角色草图。

- 广告设计:满足客户对图像色彩和布局的需求,提高设计效率。

官网地址

官网地址

发表评论 取消回复