训练

TimesFM 2.0

TimesFM 2.0是谷歌推出的开源时间序列预测模型,采用仅解码器架构,支持处理长达2048个时间点的单变量序列,具备灵活的预测频率选择与分位头预测功能。模型通过大规模自监督预训练,覆盖多个领域,具有优秀的泛化能力。适用于零售、金融、交通、环境监测等多个场景,为数据分析与决策提供支持。

GameFactory

GameFactory 是由香港大学与快手科技联合研发的AI框架,专注于解决游戏视频生成中的场景泛化问题。它基于预训练视频扩散模型,结合开放域数据与高质量游戏数据,通过多阶段训练实现动作可控的多样化场景生成。具备高精度动作控制、交互式视频生成及丰富场景支持,适用于游戏开发、自动驾驶模拟及具身智能研究等领域。

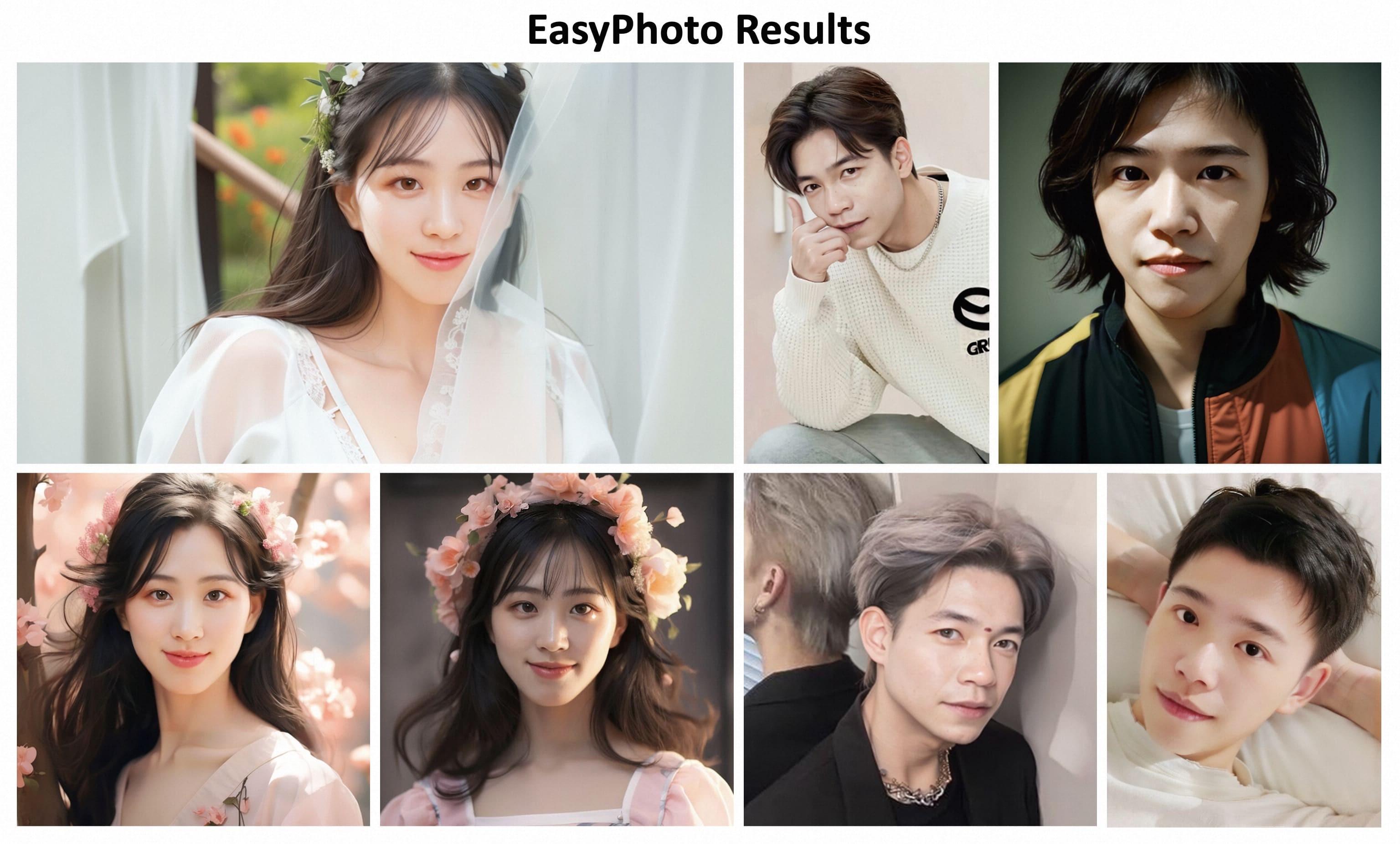

InfiniteYou

InfiniteYou 是由字节跳动推出的基于扩散变换器的身份保持图像生成框架,通过 InfuseNet 注入身份特征,确保生成图像与输入图像的高度相似。结合多阶段训练策略,提升文本与图像对齐、图像质量和美学效果。支持插件化设计,兼容多种工具,适用于社交媒体、影视制作、广告营销等多个领域。

The Language of Motion

The Language of Motion是一款由斯坦福大学李飞飞团队开发的多模态语言模型,能够处理文本、语音和动作数据,生成对应的输出模态。该模型在共同语音手势生成任务上表现出色,且支持情感预测等创新任务。它采用编码器-解码器架构,并通过端到端训练实现跨模态信息对齐。The Language of Motion广泛应用于游戏开发、电影制作、虚拟现实、增强现实及社交机器人等领域,推动了虚拟角色自